최근 AI 씬에서 상당히 재미나고 눈여겨볼만한 소식이 있었습니다. 바로 '구글 크롬에 Gemini Nano 모델이 사용자 동의 없이 설치돼 있었다' 는 논란인데요.

처음 들으면 "그게 그렇게 큰 일인가?" 싶을 수도 있습니다. 하지만 이 사건은 단순히 AI 모델 하나가 들어갔다는 이야기가 아닙니다. 동의 없는 설치, 삭제 후 자동 재다운로드, 프라이버시 문구 논란까지 이어지면서 적지 않은 파장을 낳았습니다. 이 논란은 이후 여러 매체와 팩트체크를 통해 빠르게 확산됐습니다.

이번 글에서는 이 사건이 어떻게 시작됐고, 무엇이 밝혀졌으며, 왜 많은 사람들이 분노했는지 차근차근 정리해보겠습니다.

사건의 발단 — 어떻게 드러났나

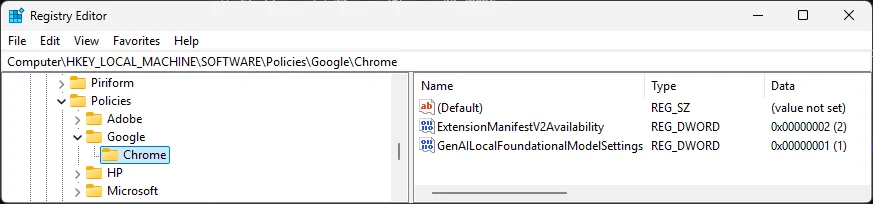

사건의 시작은 스웨덴 출신 컴퓨터 과학자이자 변호사인 Alexander Hanff의 포렌식 분석이었습니다. 그는 자신의 윈도우 환경에서 Chrome의 로컬 AppData 폴더를 살펴보던 중, OptGuideOnDeviceModel이라는 폴더 안에 약 4GB 크기의 weights.bin 파일이 존재하는 것을 발견했습니다. 이 내용은 Hanff의 원문과 이후 주요 기술 매체 보도로 널리 알려졌습니다. (출처: Alexander Hanff 원문, ghacks 기사)

문제는 이 파일이 단순한 캐시나 임시 데이터가 아니라, 구글의 온디바이스 AI 모델인 Gemini Nano의 가중치 파일로 확인됐다는 점입니다. 즉, 사용자가 따로 동의하거나 설치를 요청하지 않았는데도 브라우저가 AI 모델을 내려받아 보관하고 있었던 셈입니다.

더 놀라운 점은, 이 파일을 삭제하더라도 Chrome이 다음 재시작 때 다시 내려받는다는 사실이었습니다. 사용자 입장에서는 "내가 지웠는데 왜 다시 깔리지?"라는 의문과 동시에 강한 불쾌감을 느낄 수밖에 없었습니다. (출처: Alexander Hanff 원문, The Register 보도)

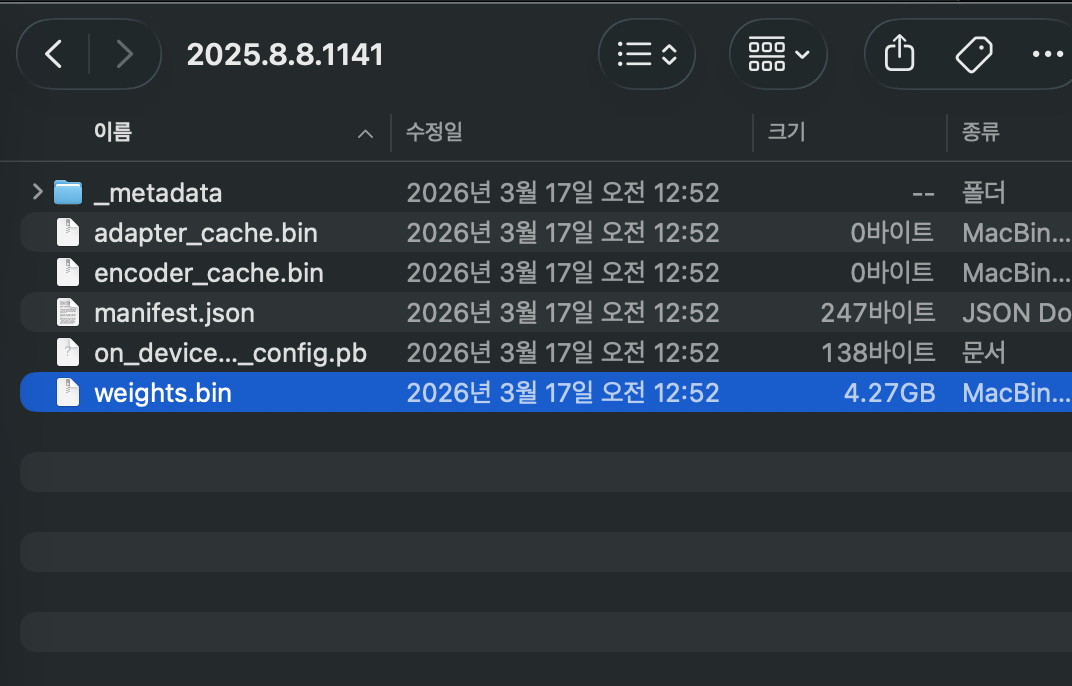

저도 위에 정보를 찾아보고 한번 맥에서 확인을 해보니 떡하니 4GB 짜리 파일이 보이더군요.

맥 파인더에서 shift + cmd + g 를 누르고

~/Library/Application Support/Google/Chrome/OptGuideOnDeviceModel를 누르면 해당폴더로 들어가 내부 파일 정보를 볼 수있습니다.

설치된 날짜가 3월 17일로 되어있는것으로 봐서는.. 아마도 꽤 전부터 잠수함 패치처럼 처리가 되어있던게 아닌가 싶습니다.

밝혀진 내용 정리 — 실제로 무엇이었나

이후 여러 매체와 팩트체크를 통해 밝혀진 내용은 비교적 명확했습니다. Chrome은 일부 환경에서 Gemini Nano 모델 파일을 자동으로 내려받고 있었고, 해당 파일의 크기는 대략 3~4GB 수준이었습니다. 이 부분은 Snopes 팩트체크에서 사실로 판정됐습니다. (출처: Snopes 팩트체크)

좀 기가막히고 무서운 내용인데요. 밝혀진 내용을 바탕으로 정리하면 다음과 같습니다.

이 부분이 특히 논란이 된 이유는, 단순히 "브라우저가 AI 기능을 지원한다" 는 차원을 넘어 사용자에게 설명하지 않은 채 대용량 파일이 깔렸다는 점 때문입니다. 설령 기능 목적이 좋았더라도, 과정이 투명하지 않으면 반발이 커질 수밖에 없습니다.

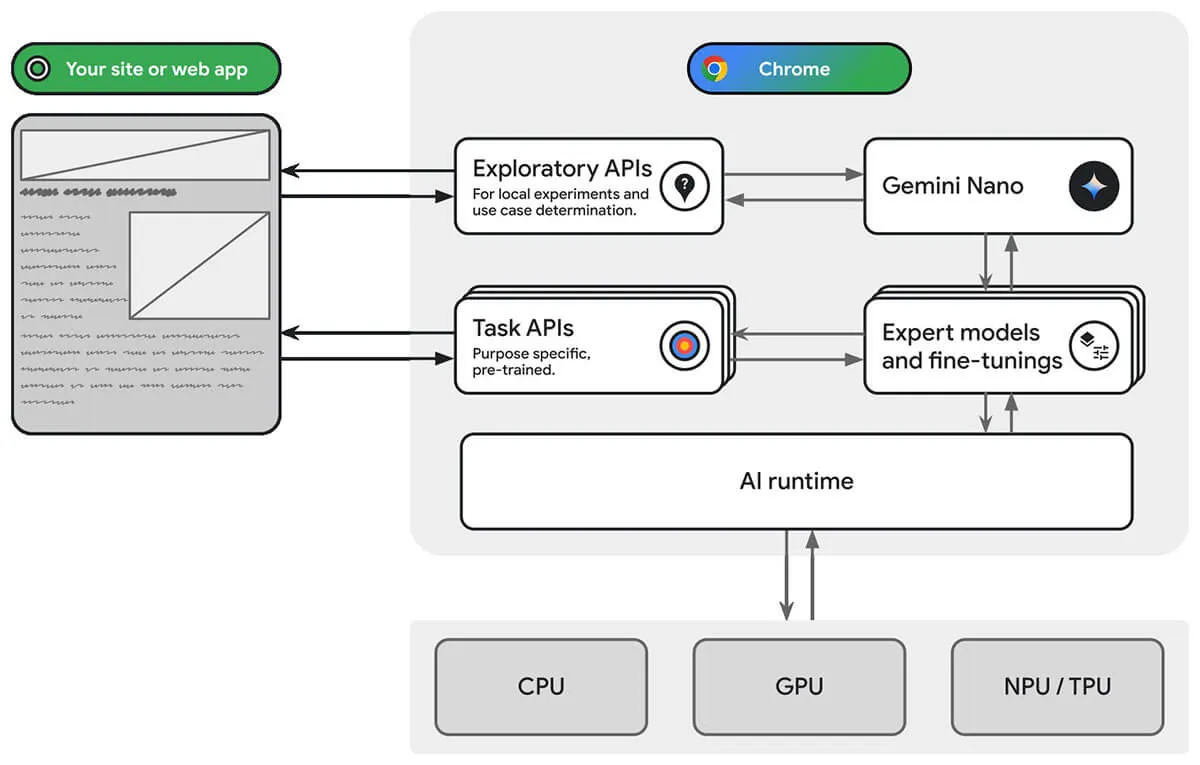

그렇다면 Gemini Nano는 정확히 어떤 모델일까요? 간단히 말하면, 이것은 클라우드가 아니라 기기 안에서 직접 처리하기 위한 소형 언어 모델입니다. 구글은 Chrome의 온디바이스 AI 기능과 관련해 이런 방향을 공식적으로 설명해왔습니다. (출처: Google 공식 Chrome AI 설명)

Gemini Nano 모델은 어떤 것일까?

그렇다면 Gemini Nano는 정확히 어떤 모델일까요? 간단히 말하면, 이것은 클라우드가 아니라 기기 안에서 직접 처리하기 위한 소형 언어 모델입니다. 구글은 Chrome의 온디바이스 AI 기능과 관련해 이런 방향을 공식적으로 설명해왔습니다. (출처: Google 공식 Chrome AI 설명)

구글은 이를 통해 글쓰기 보조, 스캠 탐지, 요약, 분류 같은 기능을 브라우저 내부에서 빠르게 처리하려는 것으로 보입니다. 즉, 사용자의 데이터를 서버로 보내지 않고 로컬에서 해결하겠다는 방향 자체는 나쁘지 않습니다.

다만 기본적인 한계점이 있는데요, Gemini Nano가 만능 AI가 아니라는 점입니다. 모델 크기와 컨텍스트 한계가 있기 때문에 복잡한 추론이나 긴 문서 처리에는 적합하지 않습니다. 결국 이 모델은 "작고 빠른 보조 도구" 에 가깝다고 보는 편이 정확합니다.

구분 | 가능한 것 | 한계 |

|---|---|---|

요약 | 짧은 텍스트 정리 | 긴 문서엔 약함 |

자동완성 | 문장 보조 | 정교한 문체 통일은 제한적 |

분류 | 스팸/피싱 탐지 | 복잡한 판단은 어려움 |

번역 | 기본적인 번역 보조 | 고품질 자연스러움은 제한 |

추론 | 단순 패턴 인식 | 복합 추론엔 부적합 |

Google의 대응과 타임라인

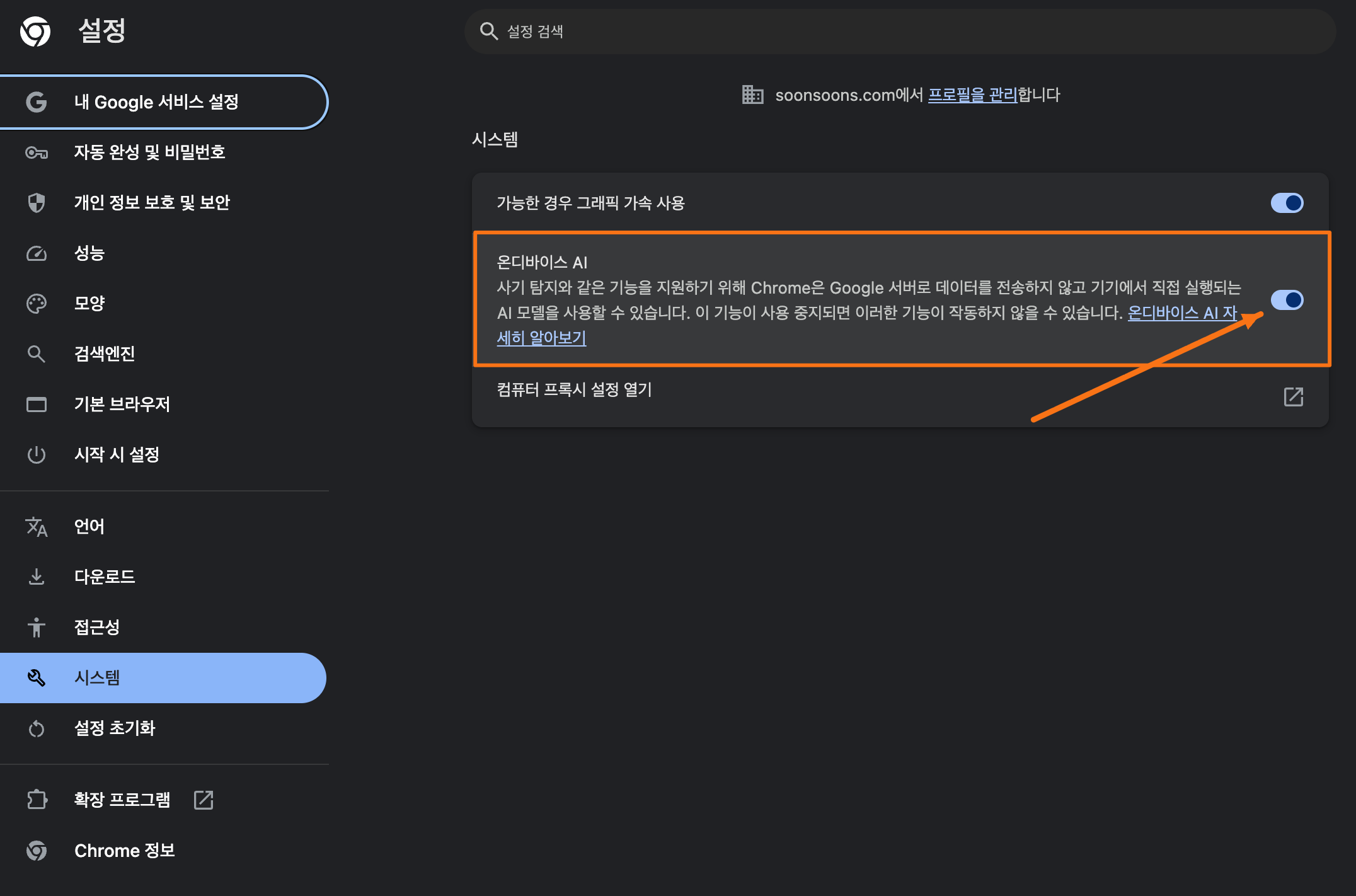

구글은 처음부터 대대적인 설명을 하진 않았지만, 이후 여러 대응을 내놓았습니다. 공식적으로는 "프라이버시 보호를 위한 온디바이스 처리"라는 입장을 유지했고, 이후에는 설정에서 끌 수 있는 옵션도 일부 사용자에게 제공하기 시작했습니다. (출처: Google Chrome AI 설명, Wired)

간단히 타임라인을 보면 다음과 같습니다.

시점 | 내용 |

|---|---|

2024년 | Chrome에 Gemini Nano 탑재 시작 |

2026년 2월 | 일부 사용자 대상 비활성화 옵션 롤아웃 |

2026년 5월 4일 | Hanff의 발견 공개 |

2026년 5월 6일 | 주요 매체 보도 확산 |

2026년 5월 7일 | Google 해명 발표 |

2026년 5월 9일 | 프라이버시 문구 수정 |

이후 | 논란 지속, 추가 해석과 비판 확산 |

이후 Chrome의 "On-device AI" 관련 설명 문구가 수정되었다는 보도도 나왔습니다. 이 부분은 논란이 단순히 기술적 이슈를 넘어서, 구글의 커뮤니케이션 방식 자체에 대한 불신으로 이어졌다는 점을 보여줍니다. (출처: The Register, Cybernews)

참고로 지금은 사용자가 수동으로 직접 비활성화를 할 수있게 되었습니다.

크롬 브라우저에서 설정 -> 시스템 -> "On-device AI" -> 끄기 를 누르면 설정을 비활성화 할수있고 위에서 알려드린 폴더로 이동. 거기서 파일을 삭제해야 제대로 지워진다고 합니다. 설정을 비활성화를 안해놓고 삭제를 하면 재부팅 후 다시 설치될 수있다고 하네요. (이런)

커뮤니티 반응 — 왜 이렇게 시끄러웠나

이 사건이 더 크게 번진 이유는 커뮤니티 반응이 상당히 강했기 때문입니다. 특히 사용자들은 "기능이 좋은가"보다 "왜 내 허락 없이 깔렸는가"에 더 민감하게 반응했습니다. 이 흐름은 각종 댓글, 커뮤니티 글, 그리고 여러 기술 매체의 반응 정리에서 반복적으로 확인됩니다. (출처: Hackaday, Malwarebytes, The Register)

분노한 쪽의 반응은 대체로 이런 식이었습니다.

" AI 기능을 꺼놨는데도 설치된다"

" 삭제해도 다시 깔리는 건 너무하다"

" 최소한 동의 창은 있어야 하는 것 아니냐"

" 프라이버시를 내세우면서 방식은 왜 이렇게 불투명하냐"

반면 옹호하는 쪽은 다음과 같은 논리를 내세웠습니다.

" 온디바이스 처리라면 오히려 프라이버시에 더 낫다"

" 스팸 탐지 같은 기능은 실제로 유용하다"

" 앞으로는 이런 방식이 일반화될 수 있다"

즉, 핵심은 "AI가 필요하냐 아니냐"가 아니라, 도입 방식의 정당성에 있었습니다.

반응 구분 | 주요 주장 |

|---|---|

분노 측 | 동의 없는 설치, 삭제 후 재설치, 불투명한 처리 |

옹호 측 | 온디바이스는 프라이버시 보호, 실용적 기능 제공 |

개발자 측 | API 가능성은 크지만 Chrome 종속성 우려 |

결국 이 사건의 본질은 무엇이었나

이 사건의 본질은 단순히 "4GB짜리 AI 모델이 깔렸다" 는 사실 그 자체보다, 사용자 동의 없는 자동 설치와 그에 대한 설명 부족에 있습니다. 기술적으로는 온디바이스 AI가 프라이버시를 보호할 수 있다는 주장도 일리가 있습니다. 하지만 사용자 경험의 관점에서는, 내가 모르는 사이에 큰 파일이 설치되고 삭제해도 다시 깔린다면 당연히 불쾌할 수밖에 없습니다. (출처: Snopes, The Register)

결국 이 사건은 다음 질문으로 이어집니다.

"좋은 기능이면 동의 없이 넣어도 되는가?"

"프라이버시를 지키는 방법이 꼭 투명해야 하는 이유는 무엇인가?"

"빅테크가 "사용자 편의"를 명분으로 어디까지 해도 되는가?"

많은 사람들이 분노한 이유는, 기술의 방향이 틀려서가 아니라 방식이 신뢰를 깼기 때문입니다. 좋은 의도였더라도 절차가 생략되면 결국 반발로 돌아온다는 점을 이 사건은 잘 보여줍니다.

마무리

개인적으로는 AI를 적극적으로 사용하는 입장에서도 이런 흐름은 자연스러운 방향이라고 생각합니다.

오타 체크, 보안 체크, 기본 기능 등 간단한 작업은 설치된 신뢰할 만한 로컬 AI를 활용해 무료로 사용하고, 장문의 글 작성, 문서 분석, 논문 이해, 수식 계산, 코딩 등 복잡한 작업은 사용자가 따로 비용을 내고 사용하는 유료 모델로 적절히 나뉘어 활용하는 문화로 자리 잡을 것이라고 봅니다.

그런 관점에서 전세계 브라우저 시장을 석권하고 있는 구글의 크롬, 그리고 안드로이드 모바일 OS, 검색 엔진 구글, 최근의 제미나이의 급부상, 구글 워크스페이스 , 구글 드라이브 등등 자신만의 생태계를 압도적으로 지니고 있는 구글의 이러한 행보는 이해가 갑니다.

다만 그 방법이 크게 잘못되었다고 봅니다.

어쩌면 많은 사람들이 우려하는 "AI는 파급력이 너무 강하기 때문에, 그 기술을 석권한 회사는 세상을 자신들 마음대로 주무를 수도 있을 것이다." 라는 내용이 어느정도 엿볼 수 있는 사건이 아닌가 싶기도 합니다.

AI 서비스 프로바이더들은 때때로 '혁신' 의 중요성이 '규제' 때문에 발목을 잡힌다고 주장하면서 그 사용성 때문에 사용자들의 프라이버시, 선택, 정보등을 멋대로 갖고 놀려는 움직임을 보이기도 합니다.

하지만 결국 전세계 모두가 안전하게 AI 를 활용하고 사용하면서 필수 서비스로 사용되기 위해서는 '안전' 과 '투명성' 이 그 무엇보다도 중요하다고 생각합니다.

이러한 관점에서 이번 사건을 정리해보면 다음과 같은 시사점이 있다고 생각합니다.

관점 | 시사점 |

|---|---|

사용자 | 내가 쓰는 소프트웨어가 무엇을 다운로드하는지 확인할 필요 |

개발자 | AI 기능은 기능만큼이나 설치/권한 설계가 중요 |

기업 | 프라이버시 메시지는 기술보다 커뮤니케이션이 더 중요할 수 있음 |

이번 사건은 구글의 삽질로 단순 헤프닝으로 치부될 수도 있겠지만 동시에 AI 윤리 의식과 동시에 온디멘드 AI 의 활성화로써의 큰 측면에서 앞으로 많은 변화를 가져올 나비효과가 될 수있다고 봅니다.

앞으로 어떤 변화로 이어질지 한번 살펴보면 어떨까요?